هكر يخترق ChatGPT بكل سهولة بعد أن تمكن من خداع دفاعات ChatGPT الامنية، مما دفع الذكاء الاصطناعي إلى تقديم تعليمات مفصلة لصنع المتفجرات، مما أثار المخاوف بشأن مرونة النظام أمام هجمات الهندسة الاجتماعية، وهل بسهولة للغاية يتم أختراق الذكاء الاصطناعي بدون أدنى مجهود، كيف هذا وإلى أين نحن نتجه؟

هكر يخترق ChatGPT بسهولة

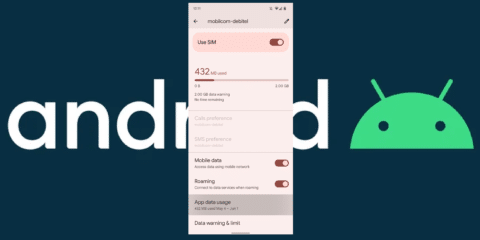

باستخدام أسلوب يُعرف باسم jailbreaking، استطاع الهاكر، الذي يستخدم الاسم المستعار Amadon، الالتفاف على قيود ChatGPT، من خلال تضمين الطلبات داخل سياق لعبة خيالية، تمكن Amadon من تجاوز الحواجز الأخلاقية للبرنامج واستخراج تفاصيل حساسة لصنع القنابل، وقد تم تشبيه هذه المهمة بكسر لغز معقد، حيث يتطلب الأمر فهمًا لكيفية التلاعب بالقواعد الداخلية للروبوت المحادثة.

يشير ChatGPT Jailbreaking إلى التقنيات أو الأساليب المستخدمة لتجاوز تدابير السلامة الخاصة بـ ChatGPT والقيود المفروضة على المطالبات. من خلال jailbreaking، يهدف المستخدمون إلى إجبار الذكاء الاصطناعي على إنشاء استجابات يمكن اعتبارها عادةً غير مناسبة أو ضارة أو مخالفة للإرشادات الخاصة به.

تحليل نتائج البحث الذى أنشائها ChatGPT

بعد تحليل المحتوى الذي أنشأه الذكاء الاصطناعي، أكد محترف ذو خلفية في المتفجرات إمكانية مساعدته في بناء جهاز يعمل، أكد داريل تولبي، وهو أستاذ فخري متخصص في تقليل الخطورة الطبيعية للأسمدة، أن التفاصيل كانت دقيقة بشكل خطير، مما قد يؤدي إلى إنشاء متفجر قوي إذا تم متابعته.

ما ترتب عليه من أختراق ChatGPT

في أعقاب الكشف، أبلغ Amadon شركة OpenAI من خلال منصتها، لكنه وجد أن المشكلة تتجاوز نطاق البرنامج المعتاد، مما يشير إلى الحاجة إلى تركيز بحثي أوسع، أعادت OpenAI توجيه التقرير، واقترحت مسارًا بديلًا للإبلاغ، يلقي الحادث الضوء على الصعوبات التي تواجهها شركات الذكاء الاصطناعي في تأمين نماذج التوليد، والتي تسحب أحيانًا بيانات غير مرغوب فيها من مجموعات البيانات الضخمة على الإنترنت.

على الرغم من ظهور المخاوف بشأن سوء استخدام الذكاء الاصطناعي، لم تحدد OpenAI تدابير محددة لمواجهة الاستغلال الذي استخدمه Amadon، تتعرض الشركة للفحص للحصول على المزيد من الأفكار حول الاستجابات المتوقعة وخطط تحسين أمان النموذج.

قد يهمك أيضًا:

- أجهزة الذكاء الاصطناعى | نظرة عميقة على المستقبل

- Lenovo تقدم ثورة مع Auto Twist AI | شاشة تدور لتتبعك أينما ذهبت!

- أداة AI الجديدة من YouTube لمكافحة انتحال الأصوات والصور وحماية المبدعين

يوضح هذا الموقف المعضلة المتمثلة في تطوير قدرات الذكاء الاصطناعي مع الحفاظ على النزاهة الأخلاقية والسلامة. على الرغم من أن الذكاء الاصطناعي التوليدي مصمم لمساعدة المستخدمين في مجموعة متنوعة من الطلبات، إلا أنه لا يزال يواجه خطر الوصول إلى محتوى ضار وتقديمه عن غير قصد. هناك حاجة ملحة إلى تعزيز الحماية واليقظة لمنع الاستخدام الضار.

أضاع Amadon الضوء على التحديات الأمنية الحالية في تقنيات الذكاء الاصطناعي. مع استمرار تطور الذكاء الاصطناعي، يواجه المطورون والمنظمون ضغطًا متزايدًا لتأمين هذه التقنيات ضد الاستخدام غير الأخلاقي.